本文主要介绍了hadoop集群验证任务存放在不同的节点上的方法,大家参考使用吧

Linux环境:CentOs6.4

Hadoop版本:Hadoop-1.1.2

master: 192.168.1.241 NameNode JobTracker DataNode TaskTracker

slave:192.168.1.242 DataNode TaskTracker

内容:想hadoop文件系统中上传一个大文件,验证文件分别分布在192.168.1.241节点和192.168.1.242节点上。

第一步: 前期工作:搭建Hadoop集群,

在hdfs-site.xml中的配置为2.

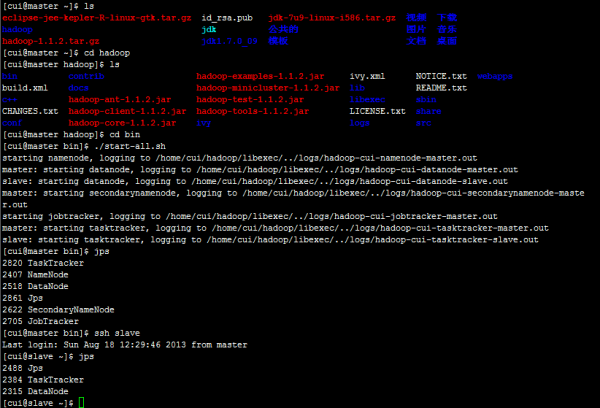

运行执行start-all.sh命令,运行结果如图所示:

查看9000和9001的信息

9000是HDFS的入口9001是MapReduce的JobTracker的入口

从以上图中可以确定Ip地址为192.168.1.241.

第二步:通过网页查看节点的个数。在浏览器中输入http://localhost:50070

以上看到LiveNodes的个数为2,说明启动成功。

第三步:上传大文件。具体步骤如图所示:

通过网页查看运行状况:

大文件已经上传成功.文件的大小是244.91MBlock的大小是64M。所以每个节点能够有4个Block。

Replication为2,表明每个Block有2个备份。

查看节点的使用情况:

从图中可以看出,此文件分成了4个Block。(TotalNumberofblocks:4)。

每个Block在两个节点上进行了备份,分别是192.168.1.241192.168.1.242

hadoop集群至此测试结束。测试成功。

以上就是hadoop入门之hadoop集群验证任务存放在不同的节点上的详细内容,更多请关注0133技术站其它相关文章!